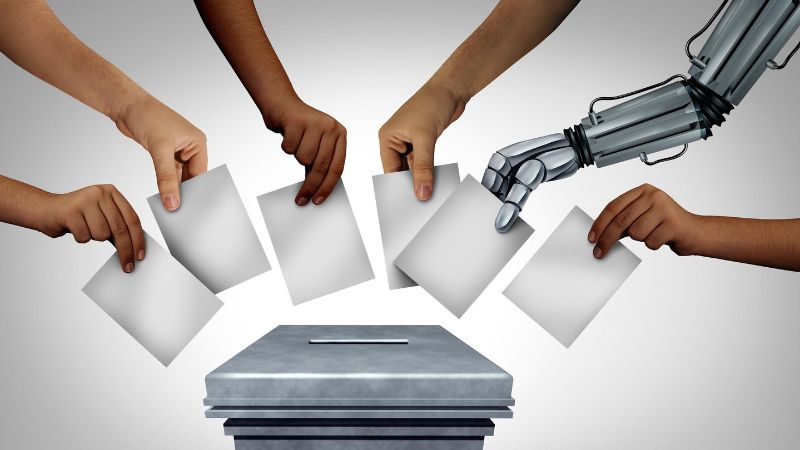

Kann KI den Ausgang von Wahlen beeinflussen?

In fast 100 Ländern – darunter Taiwan, die USA und der Senegal – gingen die Wähler in diesem Jahr an die Urnen, und während der Wahlkampagnen wurde häufig KI eingesetzt. Wenn diese Technologie in böser Absicht eingesetzt wird, etwa durch Deepfakes und Chatbots, untergräbt sie das Vertrauen der Bürgerinnen und Bürger in die Informationen von Nachrichtenagenturen, sei es im Fernsehen, online oder in sozialen Medien. KI-gesteuerte Programme haben sich eindeutig auf die Zuverlässigkeit der Informationen ausgewirkt, die wir erhalten, aber hat sich das auch auf die Wahlergebnisse ausgewirkt? Ein Forschendenteam der an der EPFL angesiedelten Initiative für Medieninnovation (IMI) führte eine Studie durch, um den Einfluss der KI auf die Wahlen im Jahr 2024 weltweit zu untersuchen. Die Ergebnisse erscheinen in der ersten Ausgabe der IMI-Zeitschrift Décryptage (nur auf Französisch). Die Ausgabe wurde vom Schweizer Journalisten Gilles Labarthe in Zusammenarbeit mit Mounir Krichane und Julie Schüpbach, beide von der IMI, und Christophe Shenk, Vorsitzender des wissenschaftlichen Ausschusses der IMI und Leiter der digitalen Nachrichtenkoordination bei der Schweizer Rundfunkanstalt RTS, verfasst.

Wiederauferstandene politische Persönlichkeiten

Die Autoren und Autorinnen der Studie betonen, dass die Verwendung digital manipulierter Inhalte zu Propagandazwecken nichts Neues ist; die KI hat diese Praxis nur noch verstärkt. Die gross angelegte Produktion und rasche Verbreitung gefälschter Inhalte – ob in Video-, Bild- oder Textform – während des Wahlkampfs haben das Vertrauen der Bürger untergraben. Die Autorinnen verweisen auch auf ein Regelungsvakuum, das die freie Verbreitung solcher Inhalte ermöglicht hat.

In einem Interview mit der Zeitschrift sagt Prof. Touradj Ebrahimi, Leiter der Multimedia Signal Processing Group der EPFL, dass Deepfakes beispiellose technische, gesellschaftliche und ethische Herausforderungen mit sich bringen: «Es ist ein Katz- und Mausspiel zwischen den Entwicklern von KI-Technologie zur Erzeugung von Deepfakes und den Entwicklern von Software zur Erkennung dieser Fälschungen». Seine Forschungsgruppe arbeitet an der Entwicklung von Systemen zur Identifizierung und Begrenzung der Verbreitung von manipulierten Inhalten (siehe unten).

Die Forschenden arbeiteten mit lokalen Fachleuten zusammen, um die verschiedenen Wahlkampagnen und Ergebnisse zu analysieren. Sie fanden heraus, dass KI-gesteuerte Programme nur einen geringen Einfluss hatten und die Wahlen weder in die eine noch in die andere Richtung beeinflussten. Die Studie fand jedoch heraus, dass die Verbreitung von manipulierten Inhalten, die durch Algorithmen gefördert wurden, die politische Meinung weiter spaltete und ein weit verbreitetes Klima des Misstrauens schuf. So wurden beispielsweise Deepfakes – Videos, die digital so verändert wurden, dass sie den Anschein erwecken, echte Menschen zu zeigen – im Wahlkampf sowohl in den USA als auch in der Schweiz eingesetzt. In Indien und Indonesien wurde die generative KI auf eine ganz neue Ebene gehoben: Programmierer liessen politische Persönlichkeiten von den Toten auferstehen, indem sie Avatare schufen, die die Wähler beeinflussen sollten.

Eine gemeinsame Anstrengung

Das IMI-Magazin bietet einen umfassenden Überblick über die Risiken, die KI für Wahlkampagnen mit sich bringt. Es enthält auch konkrete Empfehlungen von Wissenschaftlern und Wissenschaftlerinnen, anderen Fachleuten und Medienfachleuten zur Verringerung der Auswirkungen von Desinformation und schlägt Massnahmen vor, die Bürger ergreifen können. Eine Empfehlung lautet, Systeme zur Erkennung und Rückverfolgung gefälschter Inhalte einzuführen, wie sie von Ebrahimis Gruppe entwickelt werden.

Das Magazin betont, wie wichtig es ist, internationale Vorschriften einzuführen und die Medien zur Verantwortung zu ziehen. Ebrahimi hält es für unerlässlich, die kollaborative Überprüfung von Fakten zu fördern und die Bildung als mächtigen Verbündeten im Kampf gegen Desinformation zu unterstützen: «Technologie allein wird nicht ausreichen», sagt er, «die menschlichen Nutzer sind das schwache Glied – wir müssen sie für die mit Fake News verbundenen Risiken sensibilisieren und ihnen Mittel an die Hand geben, um die Quellen der Informationen, die sie erhalten, zu überprüfen.»

Schliesslich unterstreicht das Magazin die entscheidende Rolle, die Regierungen, Unternehmen und die Zivilgesellschaft dabei spielen können, den digitalen Raum sowohl ethisch als auch sicher zu gestalten. Dies erfordert eine gemeinsame Anstrengung, um das Vertrauen in den demokratischen Prozess wiederherzustellen, da die KI immer weiter verbreitet ist.

Um den Kampf gegen Desinformation zu gewinnen, muss nicht nur die richtige Technologie entwickelt werden, sondern auch – wie im IMI-Magazin erläutert – eine konzertierte Aktion von Wissenschaftlerinnen und Wissenschaftlern und Ingenieurfachleuten, Regierungen, Unternehmen und Bürgern. Gemeinsam können wir Informationen wieder verlässlich machen und das Vertrauen in den demokratischen Prozess wiederherstellen.

Das einzigartige Know-how der EPFL im Kampf gegen manipulierte Inhalte

In der Multimedia Signal Processing Group von Prof. Ebrahimi arbeiten die Ingenieurfachleute an der Entwicklung von Technologien, mit denen die Verbreitung manipulierter Inhalte wirksam erkannt und eingedämmt werden kann. Dazu gehört die Implementierung des JPEG-Trust-Standards, mit dem die Echtheit von Bildern vom Zeitpunkt ihrer Erstellung bis zu ihrer Veröffentlichung überprüft werden kann.

«Es gibt kein Patentrezept», sagt Ebrahimi, «stattdessen müssen wir mehrere Indikatoren kombinieren, um Vertrauen aufzubauen und die Risiken zu verringern». Dieser proaktive Ansatz könnte zum Beispiel darin bestehen, Inhalte mit digitalen Signaturen zu versehen, damit die Nutzenden sie zurückverfolgen und unbefugte Änderungen erkennen können.

Ebrahimis Gruppe untersucht auch den Einsatz von generativen adversarischen Netzwerken (GANs), d. h. von Netzwerken, in denen zwei maschinelle Lernprogramme gegeneinander antreten – eines produziert gefälschte Inhalte, während das andere versucht, diese zu erkennen. GANs können die Fähigkeit von Erkennungstechnologien verbessern, selbst die raffiniertesten Deepfakes zu erkennen, und damit ein wertvolles Instrument für Online-Medien und andere Inhaltsplattformen darstellen.

Förderung der Innovation in den digitalen Medien

Die IMI wurde 2018 von öffentlichen und privaten Organisationen gegründet, um die digitale Innovation im Medienbereich zu fördern. Zu den Mitgliedern gehören die EPFL, die SRG SSR, Ringier sowie die Universitäten Genf, Lausanne und Neuenburg. Die Initiative wird vom Bundesamt für Kommunikation (BAKOM) unterstützt.