Simulieren, wie Fruchtfliegen sehen, riechen und navigieren

Alle Tiere, ob gross oder klein, müssen sich mit einer unglaublichen Präzision bewegen, um mit der Welt zu interagieren. Zu verstehen, wie das Gehirn Bewegungen steuert, ist eine grundlegende Frage der Neurowissenschaften. Bei grösseren Tieren ist dies aufgrund der Komplexität ihrer Gehirne und Nervensysteme eine Herausforderung. Die Fruchtfliege, Drosophila melanogaster, hat jedoch ein kleineres und daher leichter abbildbares Gehirn, so dass Forschende detaillierte Einblicke in die Art und Weise gewinnen können, wie ihr Nervensystem das Verhalten steuert.

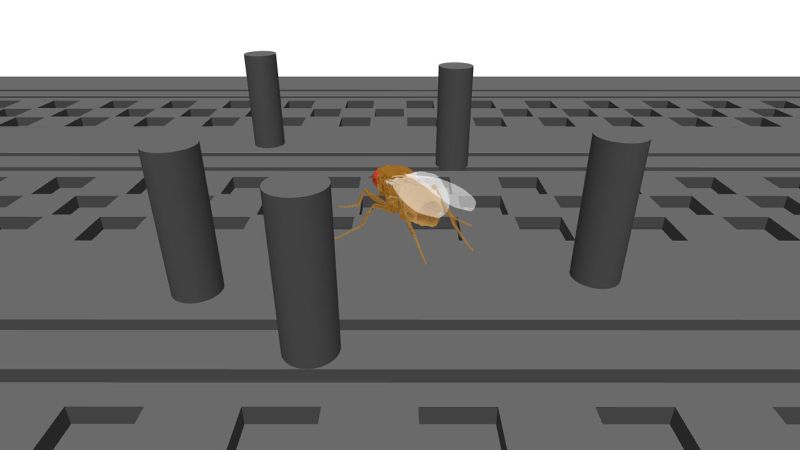

Um zu verstehen, wie das Nervensystem Handlungen steuert, haben Forschende der Gruppe von Pavan Ramdya an der EPFL eine simulierte Realität geschaffen, in der eine virtuelle Fliege so agieren und reagieren kann, wie es echte Fliegen tun. Dieses Programm mit der Bezeichnung NeuroMechFly v2 implementiert ein neuromechanisches Modell, das über die grundlegenden motorischen Funktionen hinausgeht. Durch die Einbeziehung von Sicht- und Geruchssensoren, komplexem Terrain und feinmotorischem Feedback simuliert NeuroMechFly v2, wie eine Fruchtfliege durch ihre Umgebung navigiert und dabei auf Sehenswürdigkeiten, Gerüche und Hindernisse reagiert.

Simulation von Wahrnehmung und Bewegung im realen Leben

Ramdyas Forschung konzentriert sich auf die digitale Nachbildung der Prinzipien, die der motorischen Kontrolle von Drosophila zugrunde liegen. Im Jahr 2019 veröffentlichte seine Gruppe DeepFly3D, eine Software, die mithilfe von Deep Learning erfasst, wie sich die Beine von Fliegen auf der Grundlage von Bildern mehrerer Kameras bewegen. Im Jahr 2021 stellte Ramdyas Team LiftPose3D vor, eine Methode zur Rekonstruktion von 3D-Tierposen aus Bildern einer einzigen Kamera. Diese Bemühungen wurden 2022 durch die Veröffentlichung von NeuroMechFly ergänzt, einem ersten morphologisch genauen digitalen «Zwilling» von Drosophila.

Mit der zweiten Version von NeuroMechFly haben die Forschenden nun detaillierte Merkmale hinzugefügt, die die Anatomie und Physiologie der echten Fliege nachahmen. So haben sie beispielsweise die Bein- und Gelenkwinkel sorgfältig aktualisiert, um die Biomechanik der Bewegungen der echten Fruchtfliege besser zu berücksichtigen. Das «Gehirn» des Modells kann nun visuelle und olfaktorische Informationen über virtuelle Augen und Antennen verarbeiten, so dass das sensorische Erlebnis dem einer echten Fruchtfliege nahe kommt.

Damit kann NeuroMechFly v2 verschiedene Kontrollstrategien für reale Aufgaben simulieren, wie etwa das Laufen über unwegsames Gelände oder das Drehen als Reaktion auf Gerüche und visuelle Hinweise. Das Team hat realistisches Fliegenverhalten unter verschiedenen Bedingungen demonstriert. So kann das Modell beispielsweise ein sich bewegendes Objekt visuell verfolgen oder zu einer Geruchsquelle navigieren, während es Hindernissen auf seinem Weg ausweicht.

Modellierung neuronaler Aktivitäten zum Verständnis der wichtigsten Verhaltensweisen der Fruchtfliege

NeuroMechFly ermöglicht es den Forschenden auch, aus den Erfahrungen der Fliege in der virtuellen Welt auf neuronale Aktivitäten im Gehirn zu schließen: «Durch die Kopplung von NeuroMechFly v2 mit einem kürzlich veröffentlichten Computermodell des visuellen Systems der Fliege können die Forscherinnen und Forscher nicht nur ablesen, was die Fliege in der simulierten Umgebung sieht, sondern auch, wie reale Neuronen darauf reagieren könnten», sagt Sibo Wang-Chen, der die Forschung leitete.

Mit dem Zugang zu diesen neuronalen Aktivitäten konnten die Wissenschaftlerinnen und Wissenschaftler modellieren, wie die Fliege eine andere Fliege verfolgen könnte - zum Beispiel während der Balz - und zwar auf biologisch plausible Weise. Möglich wurde dies durch das hierarchische Kontrollsystem des Modells, das eine Interaktion zwischen übergeordneten «Gehirn»-Funktionen und untergeordneten motorischen Funktionen ermöglicht - eine Organisation, die nachahmt, wie reale Tiere sensorische Eingaben verarbeiten und ihren Körper kontrollieren.

Schließlich können Forscherinnen und Forscher NeuroMechFly v2 auch verwenden, um zu untersuchen, wie das Gehirn sensorische Signale integriert, um den Zustand des Tieres zu erfassen. Um dies zu demonstrieren, hat Ramdyas Team die Fähigkeit der Fliege nachgebildet, Rückkopplungssignale von Beinbewegungen zu nutzen, um ihren Standort zu verfolgen - ein Verhalten, das als Pfadintegration bezeichnet wird. Dank dieser Eigenschaft «weiß» die simulierte Fliege, wo sie sich befindet, selbst wenn ihre visuellen Informationen begrenzt sind. Diese Art der geschlossenen sensorischen Verarbeitung ist ein Markenzeichen biologischer Intelligenz und ein entscheidender Meilenstein für das Neuroengineering.

Gehirn-Körper-Koordination als Inspiration für Robotik und KI

Insgesamt ermöglicht NeuroMechFly v2 den Forscherinnen und Forscher zu untersuchen, wie das Gehirn wichtige Verhaltensweisen mithilfe von Computermodellen steuert. Dies ebnet den Weg für tiefere Einblicke in die Gehirn-Körper-Koordination, insbesondere bei Arten mit komplexen sensorisch-motorischen Systemen. In Zukunft könnte dieses Modell als Vorlage für die Entwicklung von Robotern dienen, die sich anhand von sensorischen Hinweisen orientieren, z. B. Gerüche wahrnehmen oder ihre Bewegungen anpassen, um ihre Sicht zu stabilisieren, wie echte Tiere, die ihre Umgebung erkunden.

Durch die Verbesserung der Modelle für maschinelles Lernen, die diese Simulationen steuern, können die Forschenden auch lernen, wie die Intelligenz von Tieren den Weg für KI-Systeme ebnen kann, die autonomer und robuster sind und besser auf ihre Umgebung reagieren.